С момента зарождения поисковых систем очень многое изменилось. Раньше поисковик Google работал очень просто: в его алгоритме были заложены определенные параметры качества, в соответствии с которыми он формировал свою выдачу. Но со временем появились «умные люди», которые захотели манипулировать поисковой выдачей. В связи с этим поисковой системе пришлось разрабатывать новые фильтры, которые дали бы возможность накладывать санкции на некачественные сайты, манипулирующие выдачей и не приносящие пользы посетителям.

На сегодняшний день в поисковой системе Google работает два совершенно разных алгоритма, направленных на борьбу с некачественными сайтами: Panda и Penguin. Остановимся на особенностях каждого из них.

Google Panda

Поисковый алгоритм Panda направлен для борьбу с сайтами, содержащими некачественный контент.

Против кого работает этот алгоритм?

Как было сказано в самом начале, многие люди увидели выгоду в работе с поисковыми системами, ведь интернет — это огромнейшие просторы для заработка денег. Они начали создавать низкокачественные сайты с целью продажи рекламы либо для других способов получения прибыли. Такие сайты создаются за пару дней: весь контент, как правило, скопированный либо вообще отсутствует. Вот против таких сайтов и пришлось разрабатывать алгоритм. Со временем люди умнели и придумали еще один быстрый способ обмана поисковой системы — автоматически сгенерированный текст, который не имеет никакого смысла, либо автоматически переведенные тексты с других языков. Но на данный момент алгоритм и это учитывает.

Также поисковые системы не любят сайты, у которых много дублей страниц, даже если они наполнены уникальным и полезным контентом. Почему? Все просто: каждая страница весит определенное количество байт, и в интернете таких страниц миллиарды. Всю эту информацию поисковая система хранит у себя на серверах, которые необходимо поддерживать и оплачивать. Для индексирования и хранения у себя дублей страниц компания Google тратит миллионы долларов. Поэтому ей изначально гораздо легче «научить» вас создавать качественные сайты.

Основные причины попадания под алгоритм Panda

- на сайте много пустых страниц;

- в основном неуникальное текстовое наполнение;

- некачественный контент: автоматически сгенерирован/переведен;

- наличие большого количества дублей страниц;

- большое число битых ссылок;

- другие проблемы с внутренней оптимизацией;

- обилие рекламы на сайте.

Google Penguin

Алгоритм Google Penguin направлен на борьбу с некачественной внешней оптимизацией, а точнее со ссылочной массой сайта. С каждым днем алгоритм обновляется и становится умнее.

Против кого работает этот алгоритм?

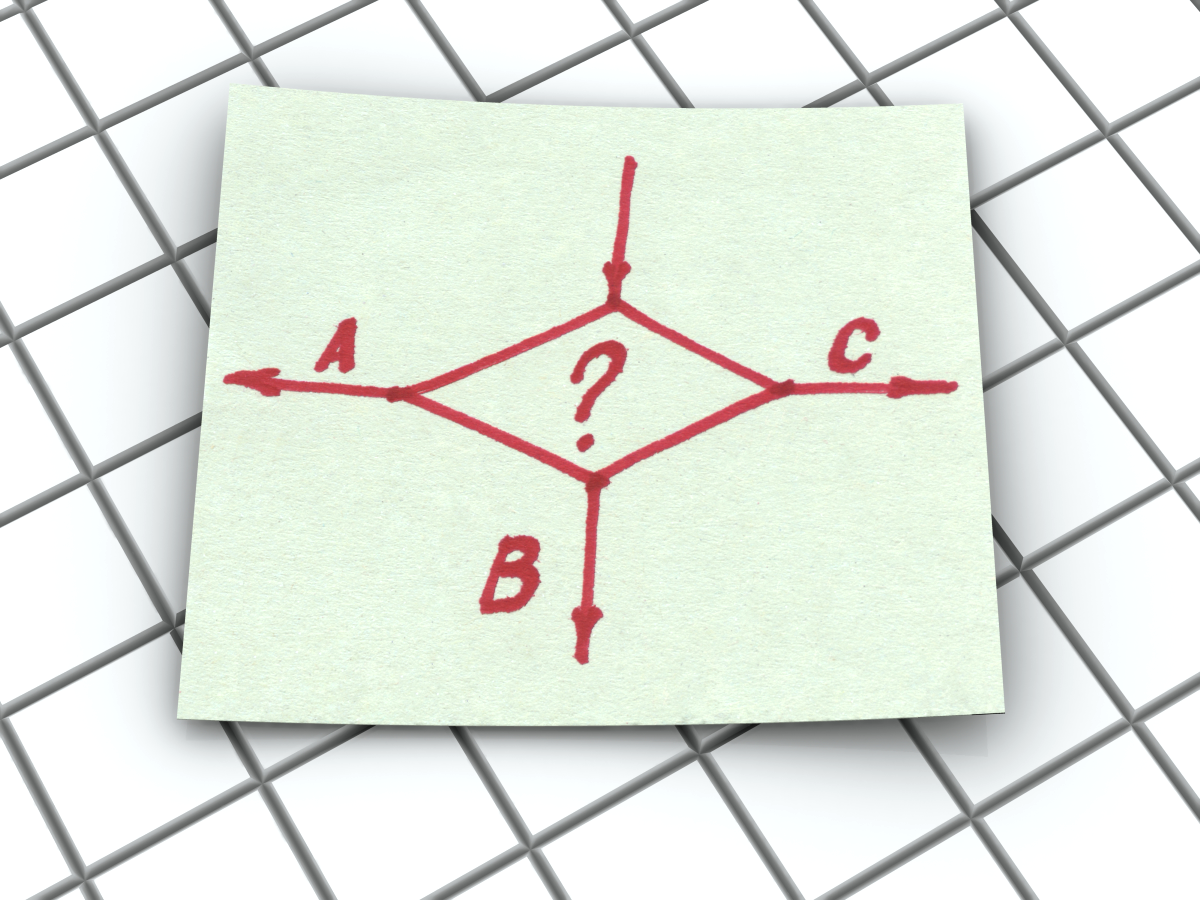

Данный алгоритм в основном борется с сайтами, владельцы которых искусственно наращивают свою ссылочную массу: либо покупают ссылки, либо размещают их вручную на разных форумах, блогах и т. д. Шанс попасть под фильтр есть даже у тех сайтов, владельцы которых вообще не занимались наращиванием ссылочной массы. Причиной служит наличие ссылок с некачественных ресурсов (каталогов, заспамленных форумов и блогов). Поисковая система Google требует, чтобы даже в таких случаях вы сами прорабатывали свою ссылочную массу и контролировали ее. Для этого существует сервис Disawov Tool.

Основные причины попадания под алгоритм Penguin

- неестественная ссылочная масса:

- агрессивный анкор-лист — большой процент прямых вхождений поисковых запросов в анкорах ссылок;

- не стественная динамика ссылочной массы — резкое увеличение либо снижение количества внешних ссылок;

- некачественная ссылочная масса:

- ссылки с заспамленных ресурсов;

- ссылки с ресурсов, которые находятся под фильтром;

- обилие сквозных ссылок.

P. S.

В данной статье я ознакомил вас с особенностями работы основных фильтров Google и причинами наложения санкций. В следующей статье я более детально, на примерах, проанализирую признаки наложения санкций и перечислю методы реанимирования сайта.